Vertraulichkeit im Alltag: Wie Hintergrund-KI unser Miteinander prägt

Gemeinsam erkunden wir heute Privatsphäre und Ethik von Hintergrund-KI in alltäglichen Interaktionen, also jene leisen Systeme, die zuhören, beobachten, antizipieren und unterstützen, ohne sich ständig bemerkbar zu machen. Wir verbinden praktische Beispiele aus Zuhause, Büro und öffentlichem Raum mit konkreten Handlungstipps, rechtlichen Hinweisen und menschlichen Geschichten. Ziel ist Orientierung, nicht Panik, damit Komfort und Sicherheit nicht gegeneinander ausgespielt werden, sondern sich gegenseitig stärken. Teilen Sie Ihre Erfahrungen, stellen Sie Fragen und gestalten Sie verantwortungsbewusste Regeln mit.

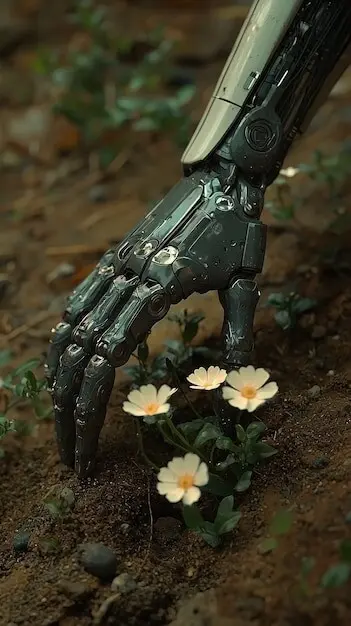

Unsichtbare Begleiter: Was Hintergrund-KI wirklich tut

Hintergrund-KI wirkt leise, indem sie Signale aus Sensoren, Geräten und Diensten verknüpft, um Situationen vorherzusagen und passende Handlungen vorzuschlagen. Sie dimmt Lichter, filtert Benachrichtigungen, schlägt Routen vor oder sichert Eingänge, oft ohne expliziten Befehl. Diese Bequemlichkeit entsteht durch Modelle, die Muster lernen, Kontext verstehen und Wahrscheinlichkeiten gewichten. Doch dieselben Mechanismen können intime Details offenbaren, wenn Gestaltung, Voreinstellungen und Verantwortlichkeiten unklar sind. Ein guter Einstieg beginnt mit Verständnis: Welche Daten fließen, welche Entscheidungen passieren, und wie werden Fehleinschätzungen bemerkt und korrigiert?

Transparenz, die wirklich hilft statt abzulenken

Lange PDFs überfordern. Besser wirken gestaffelte Hinweise: eine klare Übersicht beim Start, kurze Erklärfenster beim Ereignis und eine jederzeit zugängliche Chronik. Ergänzend liefern Modellkarten, Datenflüsse und Risikoprofile Substanz, ohne Fachjargon zu verstecken. Wichtig sind Beispiele: Warum erhielt ich diese Erinnerung, weshalb blieb die Kamera dunkel, und wie ändert sich das durch meine Auswahl? Wenn Menschen Entscheidungen nachvollziehen können, entsteht aktive Kontrolle statt resignierter Zustimmung. Transparenz endet nicht bei Worten, sondern umfasst Werkzeuge und reale, überprüfbare Einblicke.

Fairness beginnt mit den Daten und endet bei den Ergebnissen

Ein Datensatz, der Schichtarbeit, Dialekte oder Mehrpersonenhaushalte kaum abbildet, benachteiligt genau diese Gruppen. Fairness verlangt bewusste Abdeckung realer Vielfalt, statistische Prüfungen und fortlaufende Korrekturen. Gleichzeitig müssen Privatsphäre-Metriken mitlaufen, damit Schutz nicht verloren geht. Berichte über Fehlerraten nach Segmenten, unabhängige Red-Teams und beschwerdefreundliche Prozesse senken Schaden. Fairness ist nie abgeschlossen, sondern bewegt sich mit Gesellschaft, Technik und Erwartungen. Wer Ergebnisse konsequent misst, teilt und verbessert, schützt Menschen besser als Versprechen je könnten.

Einwilligung als fortlaufender Dialog, nicht als einmaliger Klick

Zustimmung veraltet, wenn Kontexte wechseln: neue Funktionen, zusätzliche Sensoren, geänderte Partnerlisten. Deshalb braucht es granulare Schalter, leicht zugängliche Rücknahmen und gezielte Anfragen im Moment der Entscheidung. Gleichzeitig droht Ermüdung, wenn zu oft gefragt wird. Lösung: risikobasierte Priorisierung, verständliche Voreinstellungen und regelmäßige Zusammenfassungen, die schnell anpassbar sind. Wichtig ist, Kinder, Gäste und seltener Nutzende mitzudenken. Einladende Sprache, klare Symbole und menschlicher Support verwandeln Zähneknirschen in echte Mitgestaltung.

Werte in Code: Ethisch handeln jenseits von Schlagworten

Ethik beginnt nicht bei Hochglanzversprechen, sondern bei konkreten Entscheidungen: Welche Daten wirklich nötig sind, wie Unsicherheit kommuniziert wird, wer Fehler ausbaden muss. Autonomie, Gerechtigkeit und Fürsorge müssen in Messbarem landen: verständliche Erklärungen, überprüfbare Grenzen, korrigierbare Entscheidungen. Machtverhältnisse zählen, denn viele Nutzerinnen tragen unsichtbare Lasten, wenn Systeme falsch liegen. Gute Praxis bedeutet, Betroffene früh einzubeziehen, Betreuungs- und Eskalationspfade zu definieren und Rückmeldungen wertzuschätzen. So wird aus hehren Worten verlässliches Verhalten, das Vertrauen verdient und langfristig Bestand hat.

DSGVO in der Praxis: Von Prinzipien zu Entscheidungen

Zweckbindung verhindert, dass Sicherheitsdaten still zu Marketingzwecken werden. Datensparsamkeit limitiert Erfassung, Aggregation und Aufbewahrung. Der Abwägungstest zu berechtigten Interessen verlangt echte Interessen, geeignete Maßnahmen und Widerspruchsmöglichkeiten. Rechte auf Auskunft, Berichtigung und Löschung müssen ohne Hürden funktionieren. Protokolle, Einwilligungsnachweise und Auftragsverarbeitungsverträge gehören in greifbare Ordner, nicht nur in Folien. Wer technische und organisatorische Maßnahmen messbar macht, erspart sich Krisenkommunikation. Dokumentation wirkt trocken, ist aber der Schutzschirm, wenn Zweifel aufkommen.

Zuhause, Büro, öffentlicher Raum: Verschiedene Regeln, gemeinsame Würde

Eine smarte Klingel zu Hause braucht andere Hinweise als eine Kamera im Flur eines Unternehmens. Besucherinnen können nicht stillschweigend zustimmen; Kinder verdienen besondere Sorgfalt. Im Büro zählen Betriebsvereinbarungen, Informationspflichten und klare Zwecktrennung zwischen Sicherheit und Leistungskontrolle. Im öffentlichen Raum helfen Schilder, Maskierungszonen und abgestufte Zugriffsrechte, Missbrauch zu verhindern. Gemeinsamer Nenner bleibt Respekt vor Unerwartetem: Niemand sollte durch Technik überrascht werden. Deutliche Symbole, hörbare Signale und erreichbare Ansprechpersonen sind praktische Brücken zwischen Regelwerk und Alltag.

Privacy by Design, aber konkret und greifbar

Schutz entsteht in Architektur, Standards und kleinen Interaktionen. Datenminimierung, lokale Verarbeitung, kurze Speicherfristen und robuste Anonymisierung sind Eckpfeiler, doch nur wirksam, wenn sie messbar durchgesetzt werden. Sichtbare Kontrollelemente, verständliche Dashboards und sichere Voreinstellungen geben Menschen Entscheidungsgewalt zurück. Gleichzeitig braucht es Fallbacks: Was passiert offline, wie reagiert das System bei Unsicherheit, und welche Funktionen bleiben trotz strenger Einstellungen nützlich? Gute Gestaltung akzeptiert Grenzen, kommuniziert sie ehrlich und bleibt alltagstauglich, ohne in bequeme, aber riskante Abkürzungen zu fallen.

Datenminimierung, die nützlich bleibt

Weniger sammeln bedeutet klüger wählen: Statt Roh-Audio nur Ereignis-Marker, statt Dauerstreaming kurze Auslöser, statt Nutzer-IDs flüchtige Tokens. Ephemere Speicher und strikte Rotationen reduzieren die Angriffsfläche. Modelle lernen mit abstrahierten Merkmalen, nicht mit intimen Details. Qualität leidet weniger als befürchtet, wenn Feedbackschleifen gut gebaut sind. Nutzerinnen sehen den Unterschied, wenn Dienste verständlich erklären, warum bestimmte Daten wirklich nötig sind und wie Alternativen funktionieren. Minimierung ist kein Verzicht, sondern gezielte Präzision.

On-Device-Lernen und persönliche Modelle

Personalisierung kann lokal geschehen, indem Modelle individuell an Vorlieben, Stimmen und Routinen angepasst werden, ohne Rohdaten zu zentralisieren. Federated Learning verteilt Updates, Differential Privacy dämpft Rückschlüsse. Doch neue Risiken entstehen bei Debugging, Telemetrie und Edge-Crash-Dumps. Gute Praxis trennt strikt, pseudonymisiert früh und beschränkt Uploads auf verifizierte Kennzahlen. Menschen profitieren, wenn sie Fortschritte sehen, ohne mehr preiszugeben. Dokumentierte Rücksetzoptionen und Exportfunktionen stärken Selbstbestimmung und mildern Abhängigkeiten von einzelnen Plattformen.

Bedienoberflächen, die Vertrauen schaffen

Kontrolle wird genutzt, wenn sie auffindbar, verständlich und verlässlich reagiert. Klare Schalter pro Sensor, farbige Statusanzeigen, erklärende Tooltips und kontextbezogene Hilfen senken Hürden. Ein Privatsphäre-Dashboard sollte Ereignisse protokollieren, Entscheidungen erklären und schnelle Korrekturen erlauben. Physische Tasten, Abdeckungen und Offline-Modi sichern Fälle ab, in denen Software hakt. Regelmäßige Erinnerungen regen zur Überprüfung an, ohne zu nerven. Gute Oberflächen fühlen sich wie Begleitung an, nicht wie ein Rätsel mit versteckten Fallen.

Geschichten aus dem echten Leben: Kleine Entscheidungen, große Wirkungen

Anekdoten zeigen, wie Regeln auf Wirklichkeit treffen. Eine smarte Klingel beruhigt, bis Nachbarinnen sich beobachtet fühlen. Ein Büro verbessert Auslastung, doch Sensoren messen plötzlich Verhalten. Ein Auto hört Befehle, aber speichert auch Pannenbeschreibungen. In jeder Geschichte stecken Optionen: Maskierung statt Vollbilder, strengere Zonen statt flächiger Erfassung, Just-in-Time-Erklärungen statt kryptischer Logs. Wenn Menschen verstehen, warum etwas geschieht, akzeptieren sie klügere Grenzen. Austausch, Feedback und gemeinsames Nachjustieren verwandeln Technik in verlässliche Helferin statt misstrauischen Schatten.

Die smarte Türklingel der Nachbarin

Die Klingel erkannte Pakete zuverlässig, doch erfasste auch Spaziergänge auf dem Bürgersteig. Nach Beschwerden aktivierte die Besitzerin Privatzonen, anonymisierte Gesichter und verkürzte Speicherfristen. Plötzlich sank die Benachrichtigungsflut, und das Vertrauen kehrte zurück. Eine kleine Lernkurve ersetzte Bauchgrummeln durch Ruhe. Wichtig war, Nachbarinnen einzubeziehen, Hinweise sichtbar anzubringen und Feedback ernst zu nehmen. So wurde aus Streit ein gemeinsames Projekt, das Sicherheit lieferte, ohne Öffentlichkeit ungewollt zu überwachen.

Die Büroküche mit Bewegungssensoren

Sensoren sollten Energie sparen, doch ein Team befürchtete Leistungsüberwachung. Die Betriebsgruppe verhandelte klare Regeln: Keine personenbezogene Auswertung, kurze Speicherfristen, aggregierte Berichte und transparente Einsicht. Eine unabhängige Stelle prüfte regelmäßig. Ergebnis: Niedrigere Kosten, bessere Luftqualität, weniger Misstrauen. Entscheidend war, Betroffene früh zu hören, technische Details zu erklären und schriftlich festzuhalten, was niemals passieren darf. Kleine Hinweisschilder, ein offenes FAQ und ein schneller Kontaktweg machten den Unterschied im hektischen Alltag.

Das Auto, das zuhört und gezielt schweigt

Die Freisprechanlage half bei Navigation und Sicherheit, speicherte jedoch Fehlerbeschreibungen länger als erwartet. Nach einem Werkstattbesuch entdeckte die Fahrerin die Log-Einträge. Der Hersteller reagierte: lokalere Verarbeitung, klarere Anzeigen und ein Löschknopf im Bordmenü. Seitdem fühlt sich die Unterstützung wieder hilfreich an, ohne Beifahrer zu werden, der sich alles merkt. Solche Korrekturen zeigen, wie Feedback, Transparenz und wirksame Werkzeuge Misstrauen abbauen und den Nutzen erhalten.

Community-Audits und offene Tests

Geteilte Prüfpläne, reproduzierbare Testdaten, anonyme Meldewege und Belohnungen für entdeckte Schwächen verbessern Qualität schneller als interne Reviews allein. Red-Teaming, Erklärbarkeitsberichte und Stressszenarien zeigen, wo Modelle irren und wie robust Schutzmaßnahmen sind. Offenheit kostet Mut, bringt jedoch Resilienz: Fehler werden früher behoben, Vertrauen wächst, und Lernkurven verkürzen sich. Wer klare Roadmaps und Ergebnisse veröffentlicht, lädt zur Mitgestaltung ein, statt nur zu versprechen. Aus Kritik entsteht Stabilität.

Interoperable Opt-outs und echte Portabilität

Abmeldesignale wie Global Privacy Control, standardisierte Ereignisprotokolle und maschinenlesbare Richtlinien erleichtern durchgehende Entscheidungen über Geräte und Dienste hinweg. Datenexporte in nützlichen Formaten geben Selbstbestimmung zurück. Übergänge zwischen Anbietern gelingen, wenn Schnittstellen dokumentiert sind und Profile sauber getrennt bleiben. Damit Auswahl real ist, müssen Sperren verschwinden und Umzüge ohne Datenverluste klappen. Menschen behalten Kontrolle, Unternehmen gewinnen Glaubwürdigkeit. So wird Vertrauen kein Lock-in, sondern ein wiederholter Beweis guter Praxis.

All Rights Reserved.